一、OpenClaw + WordPress 的核心应用场景

先明确结合的价值,避免无意义的技术整合:

内容自动化采集 / 更新:从外部网站抓取合规的文章、图片、产品信息,自动发布到 WordPress

站点数据监控:监控 WordPress 站点的核心数据(如文章阅读量、评论数、服务器状态)

自动化运营操作:自动回复评论、定时发布内容、批量修改文章标签 / 分类

竞品数据分析:抓取竞品 WordPress 站点的公开数据(如产品价格、文章布局),辅助运营决策

二、核心应用思路与技术架构

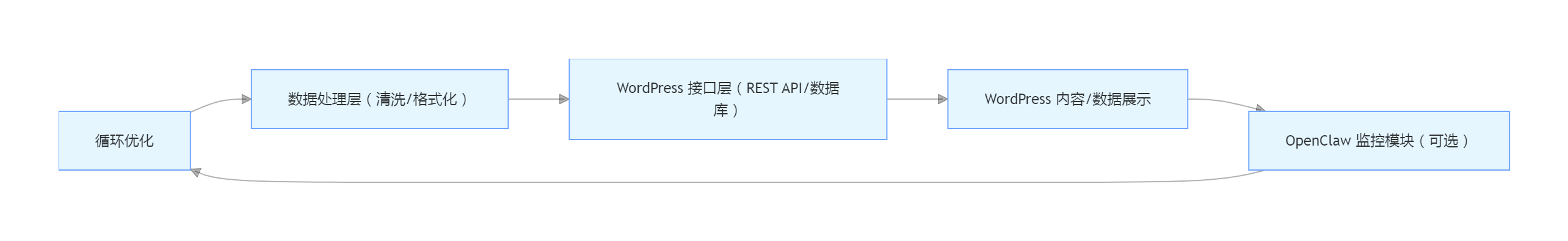

1. 整体技术逻辑

2. 具体实施步骤(以「内容自动采集发布」为例)

步骤 1:环境准备

安装 Python(OpenClaw 基于 Python 开发)

安装 OpenClaw 核心依赖:

pip install requests beautifulsoup4 python-dotenv pymysql开启 WordPress REST API(默认开启,需确保固定链接设置为「文章名」格式)

为 WordPress 创建专用 API 用户(分配「编辑」权限,避免管理员权限泄露)

步骤 2:核心代码实现(OpenClaw 对接 WordPress)

以下是可直接运行的核心代码,实现「抓取外部内容 → 格式化 → 发布到 WordPress」:

import requests

from bs4 import BeautifulSoup

import json

# 1. OpenClaw 核心配置

TARGET_URL = "https://example.com/article/123" # 目标抓取网址

WP_API_URL = "https://你的WP域名/wp-json/wp/v2/posts" # WP REST API 地址

WP_USER = "你的API用户名"

WP_PASSWORD = "你的API密码"

WP_AUTH = (WP_USER, WP_PASSWORD)

# 2. OpenClaw 数据抓取模块

def crawl_content(url):

"""抓取外部内容(OpenClaw 核心逻辑)"""

try:

response = requests.get(url, headers={"User-Agent": "Mozilla/5.0"})

response.raise_for_status()

soup = BeautifulSoup(response.text, "html.parser")

# 提取核心内容(根据目标网站结构调整选择器)

title = soup.find("h1", class_="article-title").get_text().strip()

content = soup.find("div", class_="article-content").prettify()

return {

"title": title,

"content": content,

"status": "draft" # 发布状态:draft(草稿)/publish(发布)

}

except Exception as e:

print(f"抓取失败:{e}")

return None

# 3. 对接 WordPress API 发布内容

def publish_to_wordpress(content_data):

"""将抓取的内容发布到 WordPress"""

if not content_data:

return False

headers = {"Content-Type": "application/json"}

try:

response = requests.post(

WP_API_URL,

auth=WP_AUTH,

headers=headers,

data=json.dumps(content_data)

)

response.raise_for_status()

print(f"发布成功!文章ID:{response.json()['id']}")

return True

except Exception as e:

print(f"发布失败:{e}")

return False

# 4. 主执行逻辑

if __name__ == "__main__":

# 执行抓取

crawled_data = crawl_content(TARGET_URL)

# 发布到 WordPress

publish_to_wordpress(crawled_data)步骤 3:关键优化与风险控制

反爬机制适配:

添加随机请求间隔(time.sleep(random.uniform(1, 3)))

使用代理 IP 池避免被封禁

遵守目标网站的 robots.txt 规则

数据合规性:

抓取内容前确认目标网站的版权声明

自动添加来源标注(如在内容末尾插入「本文转载自 XXX」)

WordPress 适配:

对抓取的 HTML 进行清洗,移除无用标签(避免破坏 WP 编辑器格式)

批量发布时添加「分类 / 标签」参数,符合 WP 内容结构

增加重复内容检测(通过标题查重,避免重复发布)

异常处理:

记录日志(使用 logging 模块),便于排查问题

失败自动重试(设置 3 次重试上限)

步骤 4:进阶扩展(可选)

定时执行:结合 crontab(Linux)或「任务计划程序」(Windows),实现每日自动抓取发布

批量操作:扩展代码支持多 URL 批量抓取,或批量修改 WP 已有文章

数据监控:用 OpenClaw 定时抓取 WP 站点的 Google Analytics 数据,写入 WP 自定义字段

插件化整合:将 OpenClaw 逻辑封装为 WordPress 插件,通过后台界面配置抓取规则(无需手动运行代码)

三、注意事项

合法性:严禁抓取未授权的付费内容、隐私数据,避免侵权风险

性能影响:批量操作时控制请求频率(每秒不超过 1 次),避免压垮 WP 服务器

API 限制:WordPress REST API 默认有请求限制,可通过插件(如 WP REST API Cache)优化

版本兼容:确保 WordPress 版本 ≥ 5.0(REST API 功能完整),Python 版本 ≥ 3.7

核心逻辑:OpenClaw 负责「数据抓取 / 自动化操作」,通过 WordPress REST API 实现数据互通,是「外部工具 → WP 站点」的桥梁

实施关键:先明确应用场景(采集 / 监控 / 运营),再通过 Python 实现 OpenClaw 核心逻辑,最后对接 WP API 完成落地

风险控制:重点关注反爬、版权、服务器性能三个维度,避免技术操作带来的合规或运行问题